Un afflux à haut débit d’informations non vérifiées et invérifiables

Table of Contents

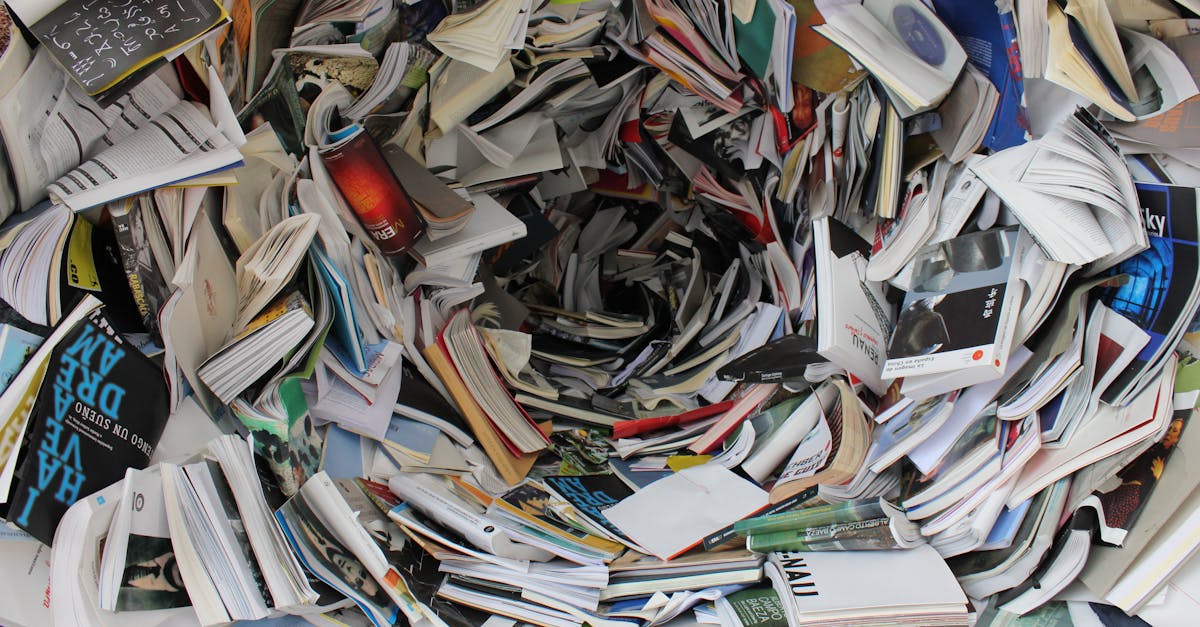

Dans le contexte actuel, la recherche en intelligence artificielle est confrontée à un phénomène alarmant : un flot incessant d’données inutiles et d’informations non vérifiées. Alors que les capacités de traitement des données augmentent, notamment grâce aux progrès des technologies comme le big data, les chercheurs font face à une arme à double tranchant. D’un côté, ces outils permettent d’analyser des volumes d’informations gigantesques ; de l’autre, ils engendrent une surcharge informationnelle qui complique la discernement des informations pertinentes.

Évaluons comment cette situation se manifeste dans le domaine académique. De plus en plus d’études, souvent générées par des algorithmes, inondent les revues scientifiques. Beaucoup de ces publications manquent de fondement solide et reposent sur des données altérées ou biaisées. Par exemple, des articles basés sur de grands ensembles de données, comme la base NHANES, peuvent produire des corrélations trompeuses, alors même qu’ils n’ont pas été minutieusement validés par des pairs.

Pour illustrer ce point, prenons le cas d’une évaluation récente à l’université du Surrey qui a mis en lumière l’impact négatif de cette prolifération d’articles générés par l’IA sur l’intégrité de la connaissance scientifique. Les chercheurs y soulignent que nombre de ces travaux sont méthodologiquement fragiles ou tout simplement inextricables. Cela crée un environnement où les travaux de valeur se retrouvent noyés sous une avalanche d’études superficielles, ce qui nuit à la pertinence de l’information.

Enfin, il est crucial que les établissements académiques mettent en place des mécanismes de filtrage des données, permettant de préserver l’intégrité de la recherche. Seule une approche rigoureuse peut garantir que les contributions faites dans le domaine de l’intelligence artificielle soient non seulement valides, mais aussi véritablement utiles pour l’avancement des connaissances.

Les défis éthiques posés par l’utilisation de l’intelligence artificielle

L’essor fulgurant de l’intelligence artificielle suscite d’importantes questions éthiques. Alors que les chercheurs explorent des solutions innovantes, la question de la responsabilité des décisions fondées sur l’IA devient de plus en plus pressante. Par exemple, lorsque des algorithmes sont utilisés pour prendre des décisions critiques en matière de santé, comme le diagnostic médical, l’absence de transparence dans le fonctionnement de l’IA peut entraîner des conséquences indésirables.

Un rapport de l’Inserm met en lumière les risques de biais dans les systèmes d’IA, qui peuvent amplifier des inégalités déjà existantes dans la société. Par exemple, les algorithmes qui sont entraînés sur des ensembles de données biaisés peuvent reproduire et accentuer ces biais, conduisant à des diagnostics erronés pour certaines populations. Cette situation appelle à une réforme des pratiques en matière de gestion de l’information et de filtrage des données.

Dans ce contexte, les chercheurs et les institutions sont appelés à élaborer des charters d’éthique qui définissent clairement les normes à suivre lors du développement et de l’utilisation des technologies d’IA. Des plateformes comme celle du CNRS intègrent déjà des recommandations sur la manière d’aborder le sujet, notamment en mettant l’accent sur la frugalité et l’usage responsable de ces technologies.

Une étude sur le développement de l’IA a révélé que le stress et la fatigue parmi les chercheurs augmentent en raison des exigences croissantes liées à cette technologie. Les chercheurs doivent non seulement produire des résultats, mais aussi évaluer les implications éthiques de leur travail. Des initiatives comme celle-ci, qui soulignent l’importance d’une approche responsable, sont essentielles pour garantir que l’évolution technologique profite réellement à la société.

Les impacts sur l’efficacité de la recherche

La surcharge informationnelle ne se limite pas à un simple problème de volume de données ; elle impacte directement l’efficacité de la recherche. Les chercheurs consacrent de plus en plus de temps à trier des données et à évaluer des sources d’informations peu fiables, ce qui détourne leur attention des travaux productifs. Dans un environnement où le temps est une ressource précieuse, cette situation devient insoutenable.

Le concept de filtrage des données devient alors crucial. Les chercheurs doivent adopter des outils et pratiques qui leur permettent de séparer le bon grain de l’ivraie. Des méthodes d’analyse avancées, telles que le machine learning et l’intelligence augmentée, peuvent aider à sélectionner les données les plus pertinentes. Par ailleurs, des initiatives collaboratives entre institutions pourraient ouvrir la voie à des protocoles d’évaluation plus rigoureux.

Un tableau récapitulatif des pratiques de filtrage pourrait inclure les éléments suivants :

| Méthode | Description | Avantages |

|---|---|---|

| Apprentissage supervisé | Utilisation d’exemples annotés pour entraîner des modèles | Précision accrue dans la sélection de données |

| Analyse sémantique | Identification des concepts clés d’un corpus textuel | Meilleure pertinence de l’information |

| Automatisation des revues systématiques | Outils qui assistent dans le tri des informations | Gain de temps significatif pour les chercheurs |

Ces méthodes permettent non seulement d’améliorer l’efficacité des processus de recherche, mais elles garantissent également que le temps investi par les chercheurs est valorisé. Cela ouvrira la voie à des explorations plus innovantes et significatives dans le domaine de l’IA.

Prévenir le chaos informationnel : rôle des institutions et des chercheurs

Il est devenu impératif que les institutions académiques et les agences de financement collaborent pour établir des normes communes visant à préserver l’intégrité de la recherche. Cela passe notamment par des programmes d’éducation continue sur les questions de gestion de l’information et les meilleures pratiques en matière d’utilisation d’algorithmes de traitement des données.

Les appels à la responsabilité éthique se multiplient. Les chercheurs, en particulier ceux travaillant dans des domaines comme la santé, doivent être formés aux risques associés à l’utilisation de l’IA, tels que la possibilité de biais et la manipulation des résultats. Un rapport publié en 2025 évoque la nécessité d’un cadre réglementaire pour garantir que ces outils soient utilisés de manière éthique et responsable.

Des initiatives comme celles lancées par le CNRS sont déterminantes pour offrir aux chercheurs les outils nécessaires pour naviguer dans ce paysage complexe. En créant un environnement encadré et plus transparent, les institutions peuvent non seulement restaurer la confiance dans l’exploitation des technologies d’IA, mais également stimuler l’innovation à long terme.

En conclusion, alors que les chercheurs combattent pour trouver un équilibre entre l’utilisation des technologies d’IA et la prévention de la désinformation, la collaboration devient essentielle. Des recherches plus intégrées et systémiques permettront à la communauté scientifique de surmonter ces défis contemporains.