À l’ère de l’intelligence artificielle, il est crucial de comprendre que les performances et les biais de ces technologies sont intimement liés aux connaissances et aux présupposés de ceux qui les conçoivent. Cet article explore comment le savoir des développeurs influence l’IA, les enjeux éthiques qui s’en dégagent, et pourquoi une collaboration entre l’IA et l’intelligence collective humaine est primordiale.

L’empreinte humaine dans l’intelligence artificielle

Table of Contents

Il est souvent dit que l’IA est le produit de l’intelligence humaine. Ce n’est pas une simple métaphore : les algorithmes d’IA apprennent à partir des données que les humains fournissent. Ainsi, les connaissances, les compétences et les biais des programmeurs se reflètent dans le comportement des systèmes d’IA. Comme le souligne Jean-Michel Loubes, « L’IA est le reflet de notre humanité ». Cela signifie que si nous voulons une IA fiable et éthique, nous devons d’abord nous assurer que les personnes qui la conçoivent réfléchissent de manière critique à leurs propres valeurs et présupposés.

Les biais et préjugés transférés à l’IA

Aujourd’hui, nous savons que l’intelligence artificielle, si elle est mal maîtrisée, peut générer des biais discriminatoires très puissants. Ces biais proviennent souvent des données utilisées pour entraîner les modèles d’IA. Par conséquent, un algorithme entraîné sur des données biaisées reproduira ces biais. Par exemple, une IA utilisée dans le recrutement pourrait discriminer en fonction du genre ou de l’origine si les données historiques de recrutement sont elles-mêmes biaisées.

Le défi éthique de la personnalisation de l’apprentissage

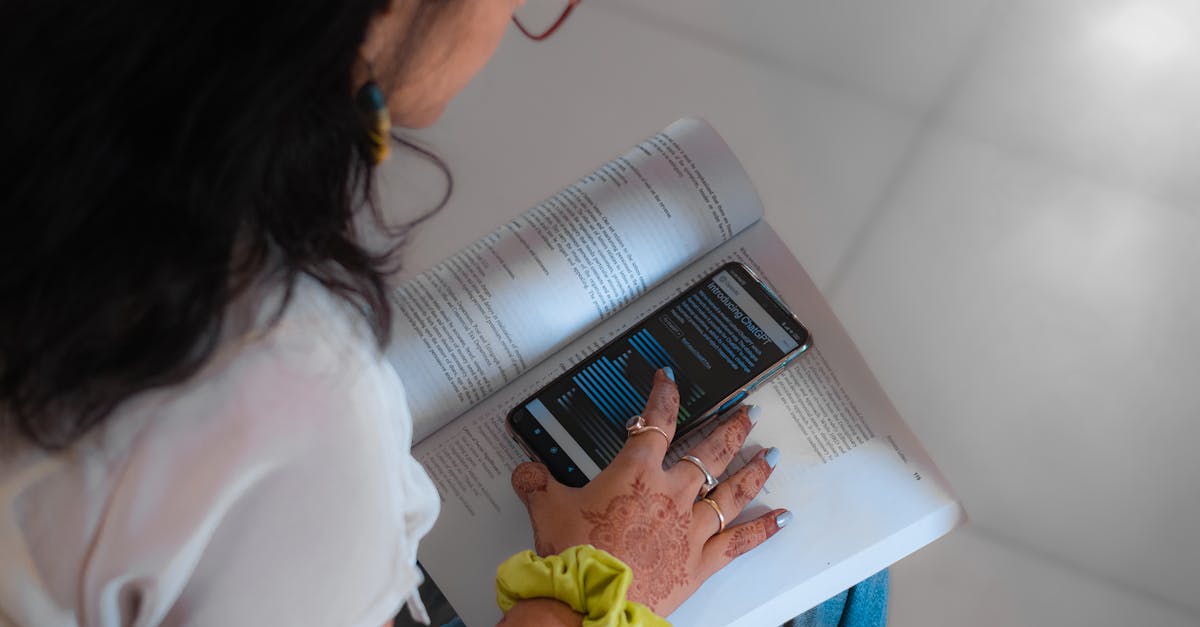

L’IA va également impacter les méthodes d’enseignement et de formation en permettant une personnalisation de l’apprentissage, en fournissant des ressources éducatives adaptées à chaque individu. Cependant, cette personnalisation n’est pas sans risques. Elle nécessite une réflexion éthique approfondie pour éviter que les systèmes n’accentuent les inégalités existantes. Le spécialiste Denis Cristol souligne l’importance d’une approche réflexive pour comprendre comment l’apprentissage et l’intelligence artificielle peuvent se croiser de manière éthique et responsable.

Les compétences humaines au cœur de l’économie de l’IA

L’avènement de l’IA nécessite une valorisation accrue des compétences humaines, en particulier des « soft skills » comme l’esprit critique et la créativité. Tous les utilisateurs de l’IA devront affûter leur esprit critique pour mettre en doute, interpréter et contrôler les résultats générés par les algorithmes. En fin de compte, c’est l’intelligence humaine qui doit guider l’utilisation et le développement de ces technologies. Il est crucial de créer une économie où les emplois valorisent les compétences qui ne peuvent être automatisées, mettant en avant la collaboration entre humains et machines.

L’importance de l’intelligence collective humaine

Face à ces défis, l’intelligence collective humaine peut jouer un rôle crucial. La pairagogie, par exemple, doit être vue comme un complément à l’IA. Des séances de formation en groupe permettent de partager et de valoriser les connaissances individuelles, enrichissant ainsi l’expérience d’apprentissage. Cela permet également de corriger collectivement les biais potentiels des systèmes d’IA, inscrivant l’humain au cœur du processus d’amélioration continue.

Quand l’art et l’intelligence artificielle collaborent

L’IA générative, qui utilise les algorithmes pour créer de nouvelles œuvres d’art, soulève une question fascinante : en quoi diffère-t-elle de la créativité humaine et comment peuvent-elles collaborer ou se compléter ? Bien que l’IA puisse générer des œuvres impressionnantes en peu de temps, contrairement à un ordinateur, le savoir humain est un vrai savoir, porteur de sens et d’intention. Une collaboration entre l’IA et les artistes humains pourrait alors engendrer des créations d’une richesse jusqu’alors inexplorée.

Conclusion : Vers une IA de confiance

Pour instaurer une IA de confiance, il est impératif de reconnaitre et de corriger ses défauts, et de fusionner les connaissances technologiques avec une réflexion éthique. En définitive, seule une approche consciente de nos propres biais et une valorisation des compétences humaines pourront garantir que l’IA serve le bien commun, plutôt que de perpétuer les inégalités existantes.